AI-агент

Блок AI-агент в J‑Graph позволяет создавать и настраивать AI-агентов. Агенты используют LLM, чтобы гибко поддерживать диалог и обрабатывать любые запросы пользователей.

Каждый агент имеет свою роль и цель. Например, агент может быть переводчиком, который работает с несколькими языками.

Чтобы начать работу:

- Настройте подключение к Caila.

- Добавьте блок AI-агент.

LLM для агента

Чтобы обращаться к LLM, агент использует сервис openai-proxy на платформе Caila.

Вы можете использовать LLM только в платном тарифе Caila.

Добавьте токен в JAICP, чтобы начать работу.

Токен доступа к Caila

Для использования сервисов и генеративных моделей из Caila в сторонних приложениях, в том числе JAICP, нужен персональный токен доступа. Чтобы выпустить токен:

-

Перейдите в Caila.

подсказкаCaila и Conversational Cloud использует общую базу аккаунтов, поэтому если вы зарегистрированы в Conversational Cloud, дополнительно регистрироваться в Caila не нужно.

-

Перейдите на страницу Мое пространство → API-токены.

-

В правом верхнем углу нажмите Создать токен.

-

Придумайте имя токена, сгенерируйте его и скопируйте в буфер обмена.

Далее добавьте токен в JAICP:

-

Перейдите в JAICP.

-

В разделе Токены и переменные добавьте новый токен:

- Название — LLM_API_KEY.

- Значение — полученный токен Caila.

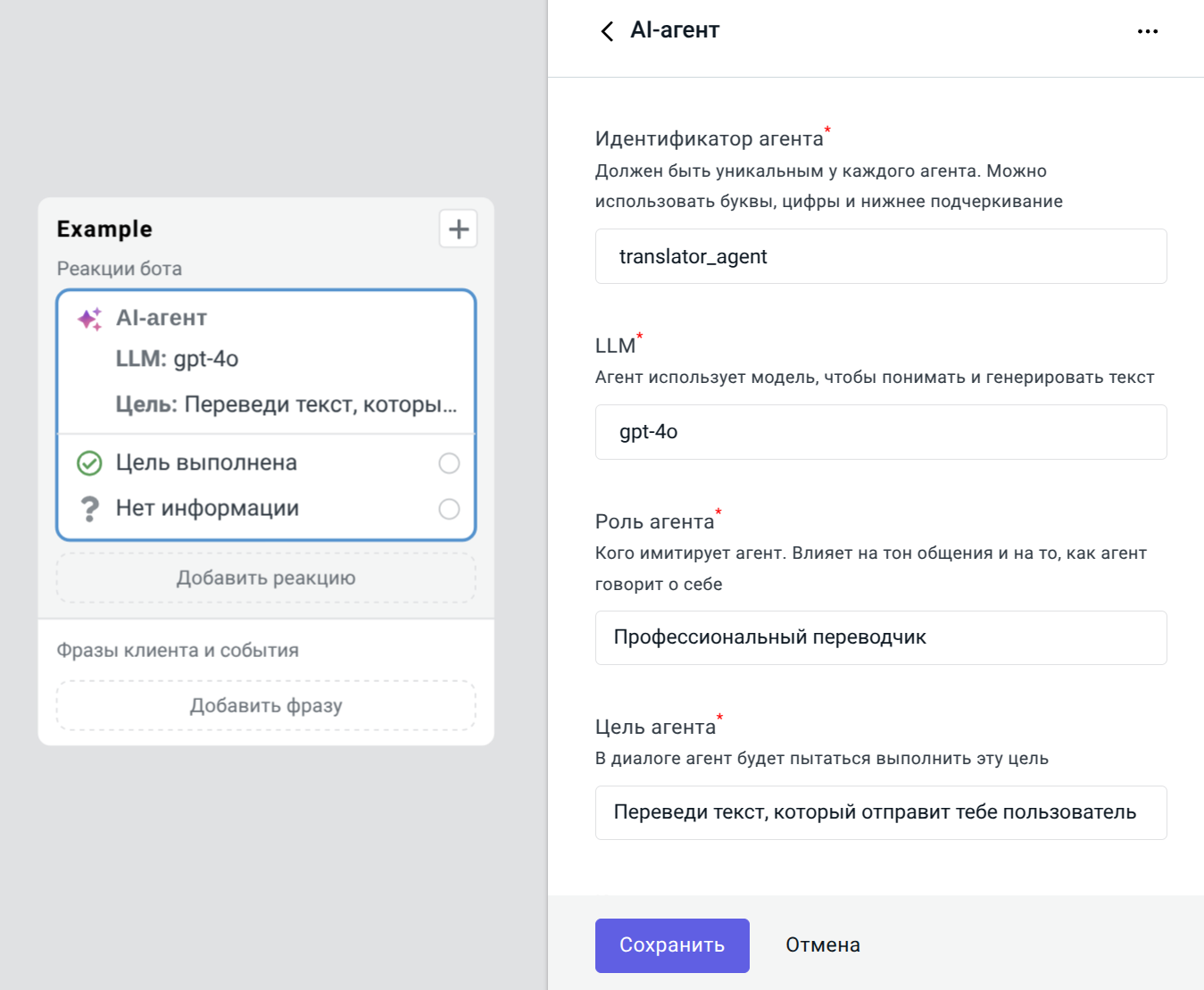

Добавление блока

Чтобы добавить блок в сценарий:

- Нажмите Добавить реакцию на шаге в J‑Graph.

- Выберите AI-агент в разделе Генеративный AI.

- Укажите параметры агента.

- Нажмите Сохранить.

Параметры

Основные

-

Идентификатор агента — каждый агент в сценарии должен иметь уникальный идентификатор. В одном шаге может быть только один блок AI-агент.

-

LLM — укажите LLM, которую будет использовать агент. Чтобы обращаться к LLM, агент использует сервис

openai-proxyна платформе Caila. Вы можете посмотреть доступные модели и их стоимость на странице сервиса.предупреждениеПараметры для переходов работают, только если LLM поддерживает function calling. Список моделей, которые поддерживают function calling, смотрите в документации OpenAI.

Сайт OpenAI недоступен для российских IP-адресов.

-

Роль агента — роль или персона агента в диалоге. Например:

Сотрудник банка. Влияет на тон общения и на то, как агент отвечает на вопросы о себе. -

Цель агента — в диалоге агент будет пытаться выполнить цель. Например:

Помоги пользователю сделать заказ. -

Инструкции — инструкции для агента. Используйте, чтобы задать поведение агента. Пример:

Отвечай только на языке пользователя. Сначала уточни, правильно ли ты понял вопрос.

Иногда LLM может давать неожиданные ответы или сообщать неточные данные.

Мы рекомендуем подробно заполнять параметры Роль агента, Цель агента и Инструкции. Так вы сможете получать более предсказуемые и стабильные результаты.

Внутри всех полей вы можете использовать подстановки значений в скобках {{}}.

Внутри скобок может находиться любое допустимое выражение на JavaScript — например, ссылка на встроенную переменную.

История диалога

Вы можете передать в агента историю предыдущего диалога с ботом. Так агент сможет учитывать контекст диалога:

- Включите параметр Передавать агенту историю диалога с ботом.

- Заполните параметр Число последних сообщений из истории.

Переходы в другие шаги

-

Разрешить агенту переводить диалог на других агентов в сценарии — если настройка включена, агент сможет сам переводить диалог в другие шаги с блоком AI-агент.

примечаниеДля этого параметра возможные переходы между агентами не отображаются на холсте J‑Graph.

При выборе шага агент учитывает:

-

Роли и цели других агентов.

-

Названия шагов, которые содержат агентов.

подсказкаМы рекомендуем давать шагам названия, которые сильно отличаются друг от друга. Агент может чаще ошибаться, если в сценарии есть шаги с похожими названиями, например:

NoMatch1иNoMatch2.

-

-

Следующий шаг, если агент выполнил цель — бот перейдет в этот шаг, если агент считает цель выполненной и у пользователя больше нет вопросов.

-

Следующий шаг, если у агента нет информации — бот перейдет в этот шаг, если агент считает, что запрос пользователя не относится к цели.

База знаний RAG

Вы можете подключить базу знаний к агенту, чтобы он учитывал данные из базы при составлении ответов. Подробнее о работе агента и подключении базы знаний смотрите в статье Использование базы знаний.

Аналитика

Агент проставляет следующий комментарий для каждой фразы пользователя: Фраза обработана тегом AIAgent.

В разделе Аналитика → Диалоги → Фразы по этому комментарию вы можете найти фразы, которые были обработаны агентом.

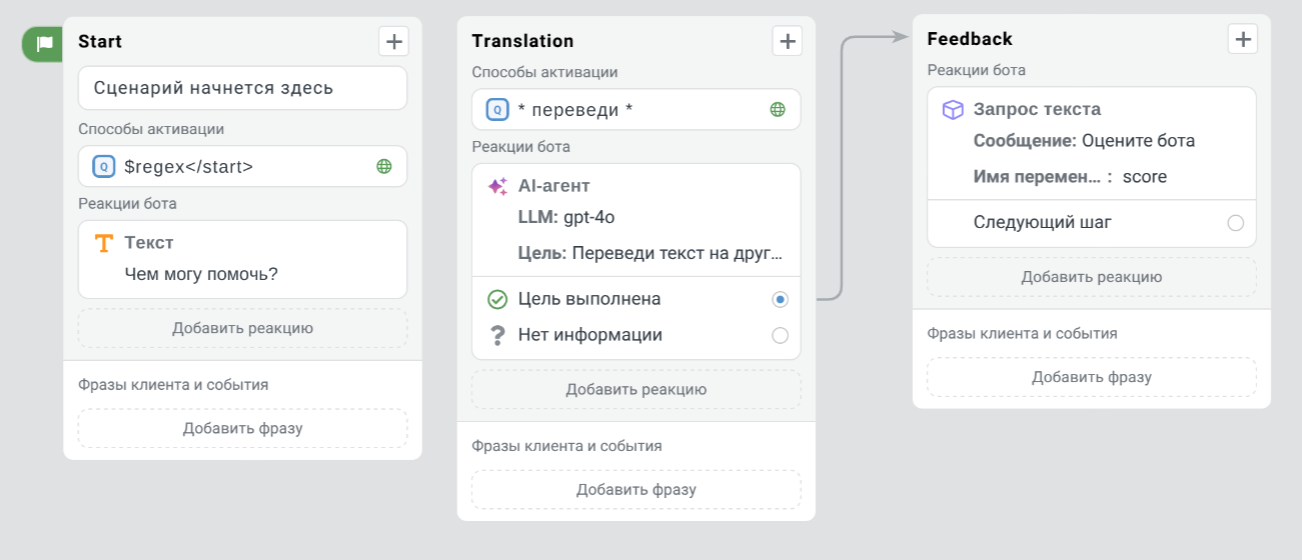

Пример

В этом примере используется один AI-агент, который переводит тексты на любые языки.

Параметры блока

- Идентификатор агента —

translator_agent. - LLM —

gpt-4o. - Роль агента —

Профессиональный переводчик. - Цель агента —

Переведи текст на другой язык. - Инструкции —

Если нужно, уточни у пользователя целевой язык. Дай 3 лучших варианта перевода. - Следующий шаг, если агент выполнил цель —

Feedback.

-

Если пользователь напишет

переведи слово «радостный», то диалог перейдет в шагTranslation. -

В шаге

Translationагент будет вести диалог с пользователем:- Агент уточнит, на какой язык перевести слово.

- Агент предложит 3 варианта перевода.

-

Если у пользователя больше нет вопросов, то диалог перейдет в шаг

Feedback.

Вы также можете использовать несколько агентов в сценарии. Смотрите статью Мультиагентный бот в J‑Graph.